Почему прогнозы Курцвейла по AGI важны

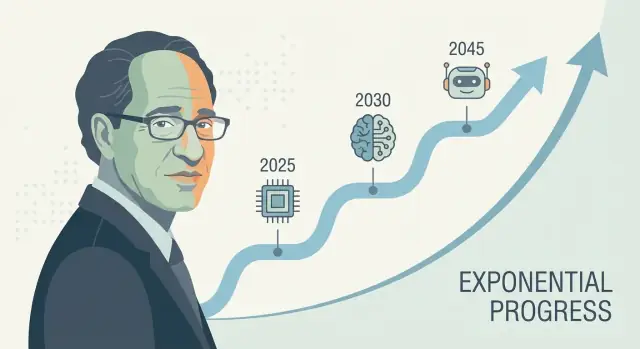

Рэй Курцвейл — один из наиболее известных голосов в долгосрочном прогнозировании технологий, особенно в области искусственного интеллекта и технологической сингулярности. Когда он делает конкретный AGI‑прогноз (часто в виде даты, а не расплывчатого «когда‑нибудь»), это обычно вызывает резонанс: инвесторы ссылаются на него, журналисты дискутируют, а исследователей просят прокомментировать.

Почему его прогнозы привлекают внимание

Влияние Курцвейла — не только в оптимизме. Речь о том, что он даёт повторяемое объяснение почему прогресс должен ускоряться — часто связанное с экспоненциальным ростом вычислений и идеей, что каждое поколение инструментов помогает создавать следующее. Согласны вы с этим или нет, он предлагает структурированный способ обсуждать временные рамки AGI, а не сводить всё к научной фантастике.

Что означает «прогноз на декады» на самом деле

Прогноз на десятилетия — это меньше про угадывание календарной даты и больше про экстраполяцию набора трендов: вычисления, стоимость, данные, алгоритмы и практическая способность строить системы, которые обобщают. Ставка в том, что эти кривые продолжат двигаться — и что сегодняшние «отсутствующие куски» являются решаемыми инженерными задачами, которые сжимаются по мере улучшения входов.

Что вы узнаете из этой статьи

В статье разбирается:

- методика Курцвейла при прогнозировании технологий (что он измеряет и экстраполирует),

- какие данные поддерживают мысль об ускорении прогресса ИИ — и где данных мало,

- сильнейшая критика прогнозов ИИ, опирающихся на прямую экстраполяцию экспоненциального роста,

- практические выводы о том, как использовать прогнозы в планировании, не принимая их за аксиомы.

Короткое замечание об неопределённости

Даже среди серьёзных экспертов сроки появления AGI сильно разнятся, потому что они зависят от допущений: что такое «AGI», какие узкие места важнее и как быстро прорывы превращаются в надёжные продукты. Таймлайны Курцвейла влияют не потому, что они гарантированы, а потому что они достаточны конкретны, чтобы их можно было проверить — и слишком амбициозны, чтобы их просто игнорировать.

Кто такой Рэй Курцвейл?

Рэй Курцвейл — американский изобретатель, автор и футуролог, известный своими долгосрочными технологическими прогнозами и тем, что подкреплял их графиками, историческими данными и смелыми дедлайнами.

Изобретатель, предприниматель и «распознаватель паттернов"

Курцвейл впервые стал широко известен благодаря практическим изобретениям, особенно в технологиях распознавания речи и текста. Он создавал компании в области оптического распознавания символов (OCR), синтеза речи и музыкальных инструментов, и на протяжении десятилетий работал близко к реальным продуктовым ограничениям: качеству данных, стоимости аппаратуры и тому, что будут принимать пользователи. Этот менталитет «билдера» формирует его прогнозы — он склонен рассматривать прогресс как то, что можно спроектировать и масштабировать.

Он также работал в крупных технологических организациях (включая Google), что укрепило его взгляд: крупные скачки часто происходят благодаря постоянным инвестициям, лучшим инструментам и кумулятивным улучшениям, а не только изолированным прорывам.

Ключевые книги и идеи, влияющие на дебаты об AGI

Таймлайн Курцвейла по AGI часто обсуждают через его популярные книги, особенно The Age of Spiritual Machines (1999) и The Singularity Is Near (2005). В этих работах он утверждает, что информационные технологии улучшаются ускоряющимися, кумулятивными способами — и что это ускорение в конечном счёте породит машины с человеческими (а затем и превосходящими человеческие) способностями.

Согласны вы с этим или нет, его письма помогли задать рамки публичного разговора: представление прогресса ИИ как измеримого, управляемого тренда и (в принципе) прогнозируемого явления.

Быстрые определения (чтобы говорить на одном языке)

AGI (Artificial General Intelligence): система ИИ, которая может учиться и выполнять широкий спектр задач на уровне, примерно сопоставимом с человеком, адаптируясь к новым проблемам без узкой специализации.

Сингулярность: термин Курцвейла для периода, когда технологический прогресс становится настолько быстрым (и ИИ настолько способным), что он трансформирует общество непредсказуемыми, трудно моделируемыми способами.

Таймлайн: прогноз с датами и вехами (например, «человеко‑уровневый ИИ к году X»), а не просто утверждение, что прогресс продолжится.

Основные утверждения Курцвейла о таймлайнах AGI

Курцвейл неоднократно утверждал, что человеческий уровень AGI вероятен в первой половине XXI века — наиболее заметно он фокусировался на конце 2020‑х — 2030‑х годах в публичных выступлениях и книгах. Он не всегда указывает один жёсткий год, но центральная мысль стабильна: когда вычислительная мощность, данные и алгоритмы пересекут определённые пороги, системы сравняются с широтой и адаптивностью человеческого мышления.

Как AGI связывается с «сингулярностью»

В представлении Курцвейла AGI — это не финишная прямая, а триггер. После того как машины достигнут (а затем превзойдут) человеческий уровень общего интеллекта, прогресс будет кумулироваться: более умные системы помогают проектировать ещё более умные системы, ускоряя научные открытия, автоматизацию и интеграцию человека и машины. Именно эта компаундинг‑динамика он и связывает с идеей технологической сингулярности — периода, когда изменения становятся настолько быстрыми, что обычная интуиция перестаёт быть надежной.

AGI vs современные системы ИИ

Ключевая тонкость в его таймлайнах — определение AGI. Современные ведущие модели впечатляют во многих задачах, но они всё ещё как правило:

- хрупки вне шаблонов обучения,

- слабы в долгосрочном планировании и реальном заякорении в мире,

- зависят от человечески курируемых целей и оценки.

Курцвейловская «AGI» подразумевает систему, способную переносить обучение между доменами, формировать и преследовать цели в новых ситуациях и надёжно работать в открытом, разнообразном реальном мире — а не только блистать на бенчмарках.

Почему вехи важнее одной даты

Календарный прогноз легко обсуждать и трудно использовать. Вехи практичнее: устойчивое автономное обучение, надёжное использование инструментов и планирование, сильная производительность в «грязных» реальных средах и очевидная экономическая замена в множестве профессий. Даже если вы не согласны с точными сроками, такие контрольные точки делают прогноз проверяемым — и полезнее, чем ставка на год в заголовке.

Послужной список: попадания, промахи и спорные моменты

Курцвейла часто называют «серийным предсказателем», и эта репутация частично объясняет интерес к его таймлайнам AGI. Однако его трек рекорд смешан — это полезно для понимания прогнозирования: некоторые заявления были конкретными и измеримыми, другие — направленными, но расплывчатыми, а некоторые недооценивали важные ограничения.

Замечательные предсказания, ассоциируемые с Курцвейлом

В книгах и выступлениях ему приписывают прогнозы вроде:

- постоянного улучшения стоимости/производительности вычислений (продолжение трендов в духе закона Мура),

- широкого распространения распознавания речи для потребителей,

- повсеместного мобильного, всегда‑подключённого компьютинга,

- превосходства ИИ человека на узких задачах (игры, распознавание паттернов),

- усиления «человеко‑машинной» интеграции (носимые устройства, импланты, вспомогательные технологии).

Конкретные и проверяемые vs расплывчатые прогнозы

Конкретные, проверяемые прогнозы привязаны к дате и измеримому результату: «к году X технология Y достигнет показателя Z» или «большинство устройств будет иметь функцию F». Их можно проверить по публичным бенчмаркам (точность, продажи/адопция, стоимость вычислений).

Расплывчатые прогнозы кажутся правдоподобными, но их трудно опровергнуть: «компьютеры будут повсюду», «ИИ трансформирует общество», «люди сольются с технологией». Такие утверждения могут выглядеть верными, даже если детали, сроки или механизмы отличаются.

Как судить «правильность» прогноза (без подсчёта очков)

Практичный подход — отделять направление, время и специфику.

- Правильно: результат совпадает с утверждением, и время близко настолько, что это явно влияло на ожидания.

- Частично правильно: направление верно, но время сдвинулось, внедрение медленнее или результат пришёл в иной форме (например, «работает в демо» vs «работает для большинства людей большинство времени»).

- Неверно: ключевые ограничения недооценены — недостаток данных, регулирование, поведение пользователей, стоимость или разрыв между лабораторной производительностью и надёжностью в мире.

Смысл не в том, чтобы пометить прогнозы «хорошими» или «плохими», а в том, чтобы понять: уверенные, опирающиеся на данные заявления всё равно зависят от скрытых допущений — особенно когда речь о сложной социальной адопции, а не только о росте аппаратуры и алгоритмов.

«Закон ускоряющейся отдачи» простыми словами

Идея Курцвейла: когда технология улучшается, эти улучшения часто облегчают её дальнейшее улучшение. Это создаёт петлю обратной связи, где прогресс с течением времени ускоряется.

Экспоненциальные тренды без математики

Линейный тренд — это как прибавлять одно и то же каждый год: 1, 2, 3, 4.

Экспоненциальный тренд — как умножать: 1, 2, 4, 8. Сначала кажется медленным — а потом внезапно всё происходит одновременно. Курцвейл утверждает, что многие технологии (особенно информационные) следуют такому образу, потому что каждое поколение инструментов помогает строить следующее.

Почему кривые стоимость/производительность важны для его таймлайнов

Курцвейл спрашивает не только «можем ли мы сделать X?», но и «насколько дешёво мы можем сделать X?». Общая паттерна в вычислениях: производительность растёт, а стоимость падает. Когда стоимость запуска полезной модели падает, больше людей могут экспериментировать, разворачивать продукты и финансировать следующий виток — это ускоряет прогресс.

Поэтому он обращает внимание на долгосрочные кривые вроде «вычислений на доллар», а не только на яркие демо.

Где уместен закон Мура — и где нет

Закон Мура — классический пример: десятилетиями число транзисторов на чипах примерно удваивалось с регулярностью, что делало компьютеры быстрее и дешевле.

Аргумент Курцвейла не в том, что «закон Мура будет продолжаться вечно». Он шире: даже если один аппаратный подход замедлится, другие методы (лучшие чипы, GPU/TPU, параллелизм, новые архитектуры, программная оптимизация) могут поддерживать общий тренд улучшения стоимость/производительность.

Почему линейное мышление вводит в заблуждение

Люди часто прогнозируют будущее, продлевая недавние изменения с той же скоростью. Это пропускает эффекты компаундинга. Такое мышление делает ранний прогресс не впечатляющим — и зато поздний прогресс кажется «внезапным», хотя он мог предсказуемо наращиваться по кривой годами.

Какие данные поддерживают (и ограничивают) такие прогнозы

Запустите быстро

Разверните и разместите приложение, когда будете готовы, без лишней настройки.

Прогнозы типа Курцвейла обычно начинаются с измеримых трендов — того, что можно положить на график. Это сила: можно спорить об входных данных вместо чистой интуиции. Но именно там проявляются и главные ограничения.

«Лёгкие для измерения» кривые: вычисления, хранение, пропускная способность, стоимость

Прогнозисты обычно отслеживают:

- вычисления (сколько операций можно купить за доллар),

- хранение (сколько данных можно держать за доллар),

- пропускная способность (как быстро и по какой цене можно передавать данные),

- снижение стоимости (чипы, облачные инстансы, тренировки, энергия на единицу работы).

Эти кривые убедительны, потому что они долгосрочные и часто обновляемые. Если вы считаете, что AGI — это «достаточно аппаратуры + правильное ПО», эти данные кажутся надёжной опорой.

Прогресс аппаратуры ≠ прогресс возможностей

Главный разрыв: больше аппаратуры не делает систему автоматически умнее. Возможности ИИ зависят от алгоритмов, качества данных, рецептов обучения, инструментов и человеческой обратной связи — не только от FLOPs.

Полезная аналогия: аппаратное обеспечение — это бюджет, возможности — результат. Связь между ними реальна, но не фиксирована. Иногда небольшое алгоритмическое изменение открывает большие выигрыши; иногда масштабирование сталкивается с убывающей отдачей.

Почему бенчмарки и реальное использование важны

Чтобы связать «входы» (вычисления, деньги) с «выходами» (что модели действительно умеют), прогнозистам нужны:

- бенчмарки, измеряющие рассуждение, планирование и обобщение — не только сопоставление паттернов,

- реальная производительность в «грязных» условиях: надёжность, безопасность, задачи на длинных горизонтах и адаптивность.

Бенчмарки можно оптимизировать, поэтому самые убедительные сигналы комбинируют баллы тестов с доказательствами долговечной полезности.

Распространённые ошибки: аккуратные графики и скрытые узкие места

Две частые ошибки — вишлистинг кривых (выбор временных окон, которые выглядят наиболее экспоненциально) и игнорирование узких мест, таких как энергопотребление, лимиты данных, задержки, регулирование или сложность превращения узкой компетенции в общую. Эти факторы не разрушают прогнозирование, но сильно расширяют интервалы неопределённости.

Ключевые допущения долгосрочных прогнозов

Долгосрочные таймлайны AGI — включая Курцвейла — зависят не столько от одной «моментальной прорывной идеи», сколько от стека допущений, которые все вместе должны сработать. Если любой слой ослабевает, дата сдвинется, даже если прогресс продолжится.

1) Вычисления, алгоритмы и данные продолжают компаундиться

Большинство десятилетних прогнозов предполагает, что три кривые движутся вместе:

- масштаб вычислений продолжает удешевляться и становиться проще в развёртывании,

- алгоритмический прогресс даёт значительные приросты эффективности — каждая единица вычислений даёт больше возможностей,

- доступность данных остаётся достаточной — за счёт новых источников (мультимодальные данные), синтетических данных, лучших инструментов разметки или улучшенного самоконтроля.

Скрытое допущение: эти три фактора не являются полными заменителями друг друга. Если качество данных стагнирует, «включите больше вычислений» будет давать меньший эффект.

2) Физические и индустриальные ограничения не станут серьёзной проблемой

Прогнозы часто трактуют вычисления как гладкую кривую, но реальность проходит через фабрики и энергосети.

Энергозатраты, производственные мощности для чипов, экспортные ограничения, пропускная способность памяти, сетевое оборудование и сбои в цепочках поставок могут ограничивать, насколько быстро обучение и развёртывание могут масштабироваться. Даже если по теории можно получить «в 10× больше вычислений», путь к этому может быть неровным и дорогим.

3) Человеческие системы позволяют быстро внедрять

Долгосрочные прогнозы также предполагают, что общество не будет сильно тормозить внедрение:

регулирование, ответственность, общественное доверие и экономическая выгода влияют на то, будут ли продвинутые системы обучаться и широко использоваться — или останутся в узких, высокофрикционных сценариях.

4) Прирост возможностей ведёт к общности

Возможно, самое большое допущение: улучшения возможностей через масштабирование естественно сходятся к общему интеллекту.

«Больше вычислений» может сделать модели более связными и полезными, но не обязательно более общими с точки зрения надёжного переноса между доменами, автономности на длинных горизонтах или стабильности целей. Долгосрочные таймлайны часто предполагают, что эти разрывы — инженерные, а не фундаментальные барьеры.

Что может задержать AGI (даже если тренды продолжают расти)

Быстро выпустите React‑интерфейс

Создайте фронтенд на React и улучшайте его с помощью простых подсказок.

Даже при росте вычислений и размеров моделей AGI может появиться позже ожидаемого по причинам, не связанным с сырой мощностью. Несколько узких мест касаются того, что именно мы строим и как проверяем, что оно работает.

1) Целеполагание может оставаться неясным

«AGI» — не единичная функция, которую можно включить. Практичное определение обычно подразумевает агента, который умеет быстро изучать новые задачи, переносить навыки между доменами, планировать на длинных горизонтах и надёжно управлять изменяющимися целями.

Если цель постоянно сдвигается — чат‑помощник vs автономный работник vs учёный‑уровень — прогресс может выглядеть впечатляющим, но при этом не охватывать ключевые способности: долговременную память, причинное мышление или согласованное принятие решений.

2) Измерение AGI сложнее, чем измерение GPU

Бенчмарки можно обмануть, переобучить или они устаревают. Скептики хотят доказательств, что ИИ способен справиться с неизвестными задачами, в новых условиях, с низким уровнем ошибок и повторяемыми результатами.

Если отрасль не договорится о тестах, которые убедительно отделяют «отличное завершение паттернов» от «общей компетентности», прогнозы остаются домыслами, а предосторожность может замедлить внедрение.

3) Выравнивание и безопасность могут стать фактором темпа

Возможности могут расти быстрее, чем управляемость. Если системы становятся более агентными, повышается планка для предотвращения обмана, дрейфа целей и вредных побочных эффектов.

Регулирование, аудит и инженерия безопасности могут добавить времени, даже если базовые модели быстро улучшаются — особенно в высокорисковых сферах.

4) Воплощение и взаимодействие с реальным миром остаются открытыми вопросами

Многие определения AGI подразумевают компетентность в физическом мире: манипулирование объектами, проведение экспериментов, использование инструментов и адаптация к реальному времени.

Если обучение в реальном мире оказывается ненасытным по данным, медленным или рискованным, AGI может застрять на уровне «блестяще в экране», тогда как практическая общность будет ждать лучших роботов, симуляций и безопасных методов обучения.

Главные критики подхода Курцвейла

Прогнозы Курцвейла влиятельны отчасти потому, что они ясны и количественны — но именно эта ясность привлекает и жёсткую критику.

1) Экстраполяция прошлых трендов может скрывать «смену режима»

Частое замечание: Курцвейл сильно опирается на продолжение исторических кривых (вычисления, хранение, пропускная способность). Критики считают, что технология не всегда масштабируется гладко: прогресс в чипах может замедлиться, энергозатраты проявиться, экономическая мотивация измениться. Даже если общий вектор вверх, скорость может измениться так, что конкретные даты станут ненадёжными.

2) Сложные системы не дают прорывов по расписанию

AGI — не только вопрос более быстрой аппаратуры. Это проблема сложных систем, включающая алгоритмы, данные, методы обучения, оценивание, ограничения безопасности и человеческое принятие. Прорывы часто блокируются одной отсутствующей идеей — того, что трудно поставить в календарь. Сторонники скепсиса отмечают, что наука продвигается неравномерно: долгие плато сменяются резкими скачками.

3) Эффект выбора делает смелые предсказания более заметными

Ещё одна критика психологическая: мы запоминаем драматические попадания сильнее, чем тихие промахи или почти‑попадания. Если кто‑то делает много смелых прогнозов, несколько заметных совпадений могут доминировать в общественном восприятии. Это не значит, что прогнозист «неправ», но это может завысить доверие к точности таймлайнов.

4) Почему умные люди расходятся во времени

Даже эксперты, признающие быстрый прогресс ИИ, расходятся в том, что именно считать AGI, какие способности должны обобщаться и как их измерять. Небольшие разницы в определениях (широта задач, автономность, надёжность, обучение в реальном мире) сдвигают прогнозы на десятилетия — при том, что никто существенно не меняет оценку текущего прогресса.

Как другие эксперты прогнозируют AGI

Курцвейл — громкий голос, но таймлайны AGI — это широкая дискуссия. Полезно разделить её на кэмп близкого срока (AGI в ближайшие годы или пару десятилетий) и длинный‑срок (несколько десятилетий или «не в этом веке»). Часто они смотрят на одни и те же тренды, но расходятся в том, чего не хватает: сторонники ближних сроков акцентируют масштабирование и появляющиеся свойства, критики дальнего срока подчёркивают нерешённые задачи вроде надёжного рассуждения, автономности и робустности в реальном мире.

Популярные подходы прогнозирования (помимо экстраполяции трендов)

Опросы экспертов собирают мнения исследователей и практиков (например, опросы о 50%‑й вероятности «человеко‑уровневого ИИ»). Они показывают смещения мнений со временем, но зависят от того, кого опрашивают и как формулируется вопрос.

Сценарное планирование избегает выбора одной даты. Вместо этого строятся несколько правдоподобных будущих картин (быстрый прогресс, медленный прогресс, регуляторные узкие места, аппаратные ограничения) и рассматриваются сигналы, указывающие на каждую траекторию.

Прогнозирование по вехам и возможностям отслеживает конкретные контрольные точки (задачи по программированию, научное рассуждение, надёжность агентов) и оценивает, какой темп улучшений необходим, чтобы дойти до широкой компетентности.

Определения меняют дату

«AGI» может означать прохождение обширного набора тестов, выполнение большинства работ, функционирование как автономный агент или соответствие человеку во многих областях при минимальном надзоре. Чем строже определение, тем дальше оказываются сроки — и это даёт большую часть разброса во мнениях.

Ближайшее к консенсусу: неопределённость

Даже оптимисты и скептики обычно сходятся в одном: таймлайны весьма неопределённы, и прогнозы следует воспринимать как интервалы с допущениями, а не как календарные обязательства.

Сигналы, за которыми стоит следить в ближайшие 5–10 лет

Экспериментируйте, не ломая систему

Делайте смелые изменения и сохраняйте прогресс с помощью снимков и отката.

Прогнозы AGI могут казаться абстрактными, поэтому полезно отслеживать конкретные сигналы, которые должны измениться до любого «большого момента». Если подход Курцвейла в целом верен, следующая декада должна показывать стабильный рост в возможностях, надёжности, экономике и управлении.

1) Индикаторы возможностей (что системы действительно умеют)

Следите за моделями, которые надёжно планируют на много шагов, адаптируются, когда план терпит неудачу, и используют инструменты (код, браузеры, приложения) без постоянной ручной помощи. Наиболее значимый сигнал — не эффектное демо, а автономность с чёткими границами: агенты, завершающие многочасовые задачи, задающие уточняющие вопросы и безопасно передающие работу при неопределённости.

2) Индикаторы надёжности (насколько часто они ошибаются)

Прогресс будет выглядеть как снижение ошибок в реальных рабочих потоках, а не только рост баллов в бенчмарках. Следите, уменьшаются ли «галлюцинации», когда от систем требуют приводить источники, выполнять проверки или самопроверку. Важная веха: стабильная производительность в условиях аудита — та же задача, несколько прогонов, совпадающие результаты.

3) Экономические индикаторы (где проявляется ценность)

Ищите измеримые приращения производительности в конкретных ролях (поддержка, аналитика, софтвер, операции), а также новые категории работ, построенные вокруг надзора и интеграции ИИ. Важна и стоимость: если качественный вывод дешевеет (за задачу, за час), внедрение ускорится — особенно для малых команд.

4) Индикаторы управления (как общество реагирует)

Если возможности растут, управление должно перейти от принципов к практике: стандарты, независимые аудиты, отчётность о инцидентах и регулирование, проясняющее ответственность. Отслеживайте также правила мониторинга вычислений и отчётности — признаки того, что правительства и отрасль рассматривают масштабирование как управляемый и отслеживаемый рычаг.

Если вы хотите использовать эти сигналы без трагедии из‑за заголовков, см. /blog/ai-progress-indicators.

Практические выводы: как использовать прогнозы, не переполагаться на них

Таймлайны AGI лучше рассматривать как прогноз погоды на далёкую дату: полезны для планирования, ненадёжны как обещание. Прогнозы в духе Курцвейла помогают заметить долгосрочные тренды и проверить решения, но их не стоит делать единственной опорой стратегии.

Как читать прогнозы по AGI (не воспринимая их как гарантию)

Используйте прогнозы, чтобы исследовать диапазоны и сценарии, а не один год. Если кто‑то говорит «AGI к 203X», переводите это в: «Что должно произойти, чтобы это стало правдой — и что если этого не случится?» Планируйте несколько исходов.

Вопросы, которые стоит задавать любому прогнозу

- Определение: Что они понимают под «AGI»? Человеко‑уровень в тестах, широкая полезность в работе или «умеет всё»? Разные определения дают разные сроки.

- Данные: Какие индикаторы они используют — вычисления, эффективность обучения, бенчмарки, темпы развёртывания — и что игнорируется?

- Допущения: Предполагают ли они гладкое улучшение алгоритмов, доступность данных, энергию, чипы и управление?

- Мотивы: Продают ли они продукт, собирают финансирование или продвигают политику? Мотивы могут влиять на уверенность и временные рамки.

Практическое планирование: навыки, стратегия и осведомлённость о рисках

Для людей: развивайте устойчивые навыки (постановка проблемы, предметная экспертиза, коммуникация) и привычку осваивать новые инструменты.

Для бизнеса: инвестируйте в AI‑грамотность, качество данных и пилотные проекты с понятным ROI — но сохраняйте «без сожалений» стратегию, которая работает и если AGI появится позже.

Один прагматичный путь: сократите циклы разработки: прототипируйте рабочие процессы, тестируйте надёжность и количественно измеряйте прирост продуктивности перед крупными ставками. Платформы вроде Koder.ai соответствуют такому подходу: позволяют командам быстро пробовать процессы с помощью чат‑интерфейса (режим планирования, снимки состояния, откат), экспортировать исходный код по необходимости и не привязывать стратегию к одному прогнозу.

Сбалансированный вывод: таймлайны могут направлять подготовку, но не давать точной уверенности. Используйте их, чтобы приоритизировать эксперименты и уменьшать «слепые зоны» — и регулярно пересматривайте допущения по мере появления новых данных.